안녕하세요. 조씨가 알려주는 IT이야기 입니다.

이번 포스팅에서는 카메라 별 색감이 왜 다른가? 에 대해 포스팅하려고 합니다. 시네마카메라의 겨웅 ARRI ,RED 회사 별 차이가 발생하고, 일반 컨슈머 카메라에서는 DSLR, 미러리스와의 차이 등 에 대해 기술적인 분석을 통해서 실펴보고, 거의 논문에서 살펴봐야 하는 부분이기 때문에 검증된 자료에서 정리해서 알려드리겠습니다. *참고로 내용에 오류가 있을 수 있으므로, 대략적인 맥략만 파악 정도로만 봐주시면 감사하겠습니다.

1. 센서 스펙트럼 응답방식의 차이

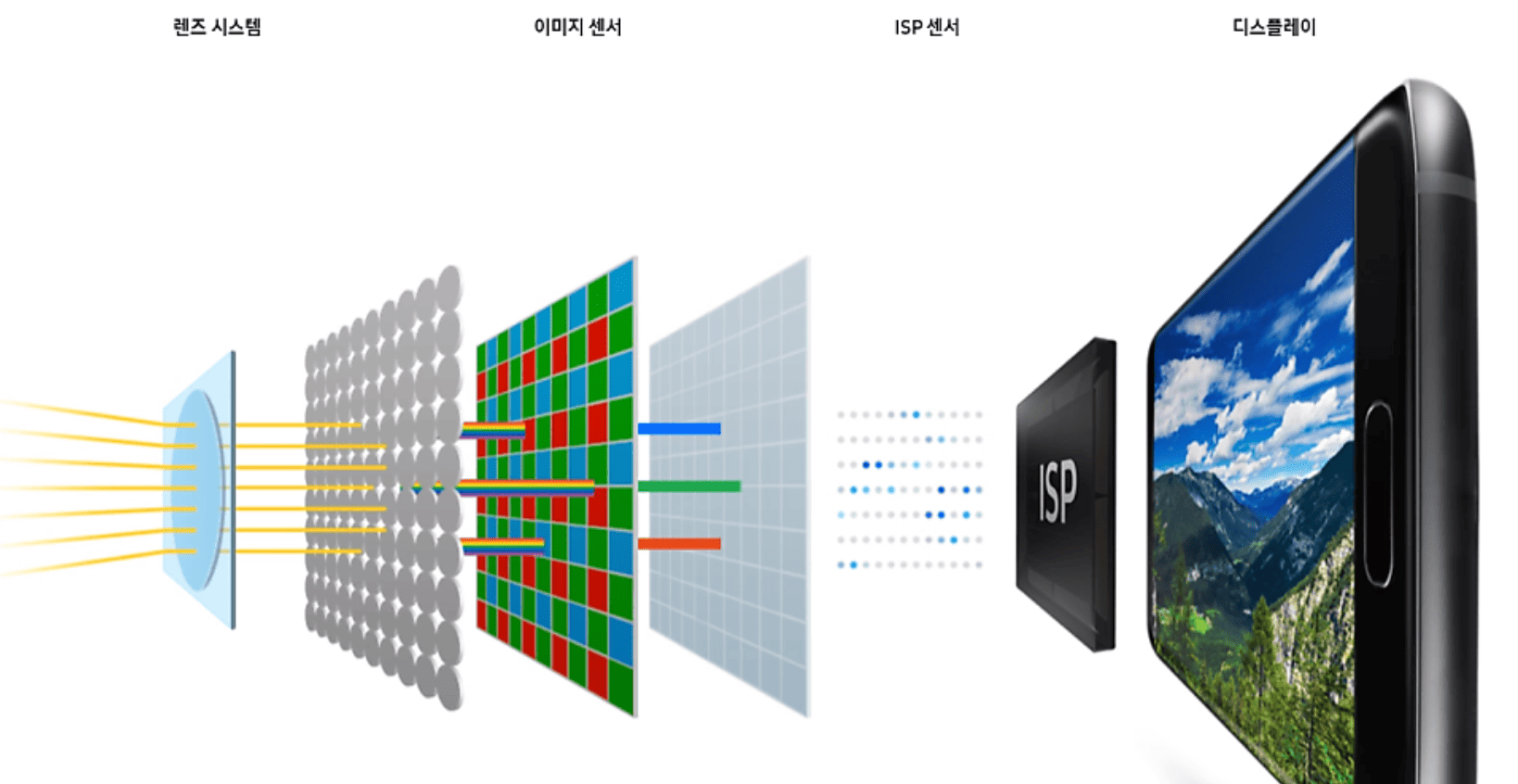

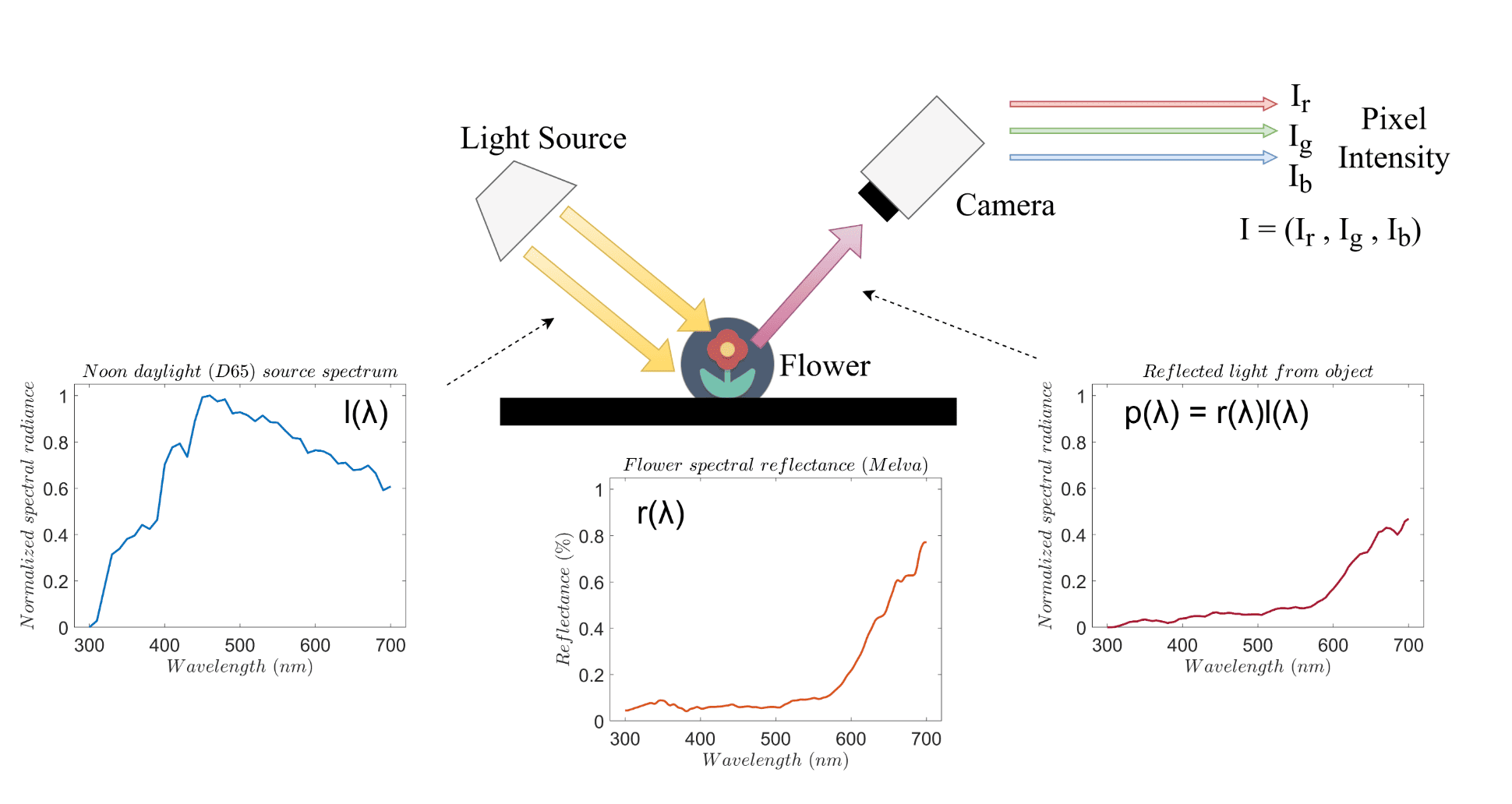

과학시간에 스펙트럼에 배우게 됩니다. 빛을 프리즘 도구를 활용하게 되면 다양한 색상의 색상을 보게 됩니다. 흔히 말하면 무지개와 동일합니다. 이 부분은 어떤 파장의 빛이 센서의 각 컬러채널 (베이어, 포베온 등) 얼마나 반응하지에 대해 나타내고, 각 장면에서 스펙트럼 에너지가 픽셀 값으로 어떻게 변환되는지 결정된다고 볼 수 있습니다.

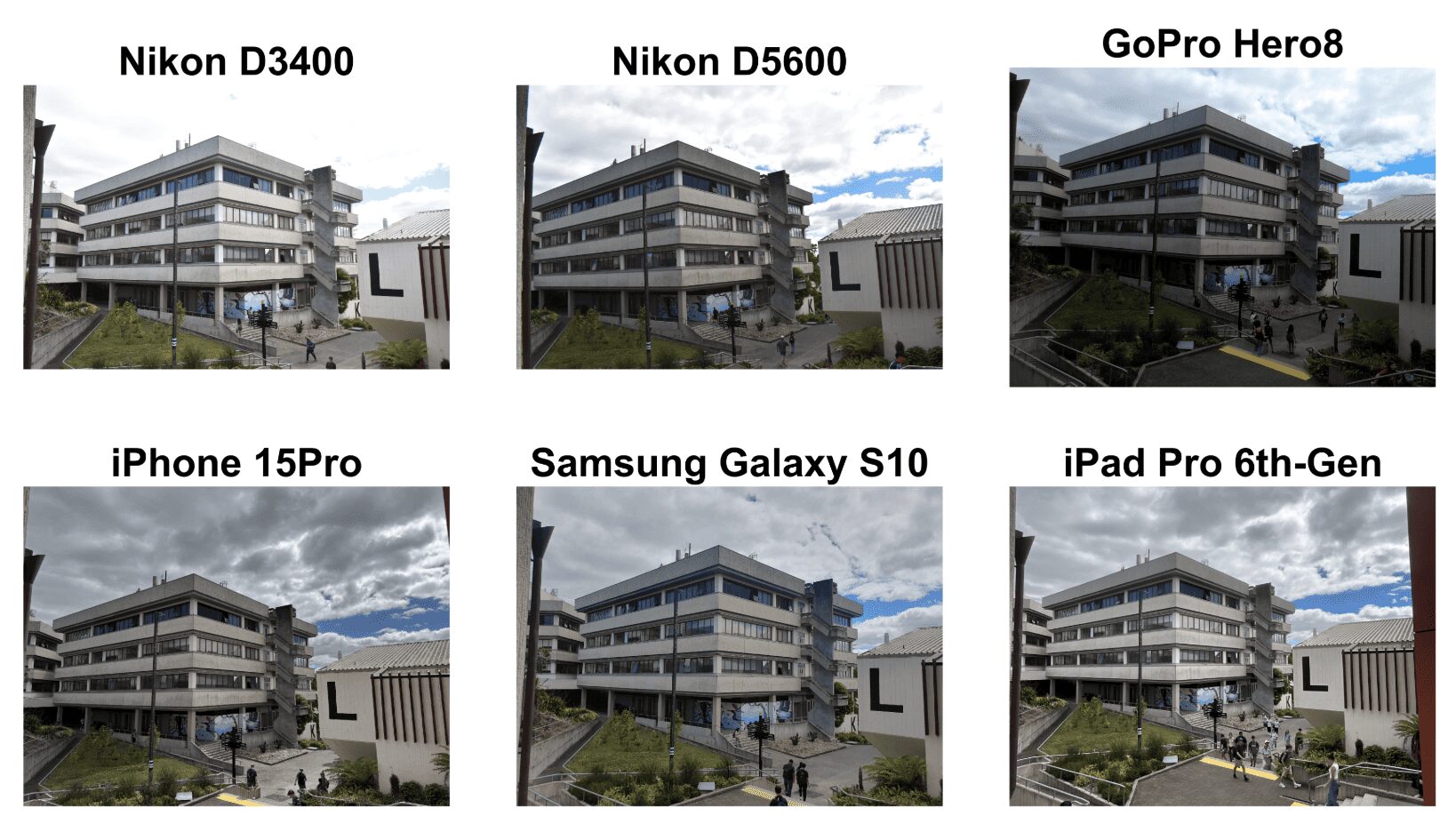

- 사진 출처. arxiv 논문 (서로 다른 카메라로 촬영한 이미지 사진입니다.

실제 사진과 영상 우리가 캡처하는 장면들은 많은 후과정 처리가 들어갑니다. 요즘은 AP 기술이 발달함에 따라 AI 영향을 받고 있으며 더불어 업스케일링 노이즈 제거 수차제거 등 다양한 요소에 관할 하게 됩니다. 또한 비네팅 및 렌즈 광량 (T값 투과율) 광학적 왜곡, 렌즈군에 따른 컬러케스트 등에도 관련이 있습니다. 그 중에 HDR 캡처 방식 등도 연관이 되는데 참고로 iPhone의 경우 셔터를 누르기 전 실시간으로 DGO(원리와) 비슷한 방식으로 캡처합니다.

ISP 과정과 맵핑과정 리덕션 등을 과정을 거치게 되면 최종적인 결과물이 나옵니다. 색감은 전자회로로 인한 발생되는 잡음과 노이즈, 핫픽셀 간섭 등의 변수에 따라 달라 질 수도 있습니다. 또한 각 회사별 최종 결과물에 따른 파이프라인 따라 다 다르다고 볼 수 있습니다.

음.. 보기 굉장히 어렵게 되어서 저도 무슨 말 하는지는 모르겠으나, 반사율과 각 픽셀별 받아들이는 강도에 따른 내용입니다. 간단하게 정리를 한다면, 스펙트럼 응답을 정확하고 보정하는 것은 색 특성과 이 과정에서 색감에 대한 영향이 발생 한다고 볼 수 있습니다. 참고로 대부분의 센서들은 우리 인간이 보는 시각과 일치하는 분광감도를 갖지 못합니다. 이 말은 즉슨 최적의 보정 과정을 진행하더라도 일부 색상은 완벽한 재현이 어렵다고 볼 수 있습니다. (특히 레드 색삼..)

번외로, 렌즈도 색상이 다르게 나타납니다. 이것은 렌즈에 따른 색상차이를 이야기 하고 빛의 처리나 유리에 따른 수차 등도 색상에 연관이 됩니다. 영화업계에서는 LOOK 특성을 잘 살려서 자연스러운 미장센으로 이용합니다.

2. 컬러 필터 어레이 방식에 따른 차이

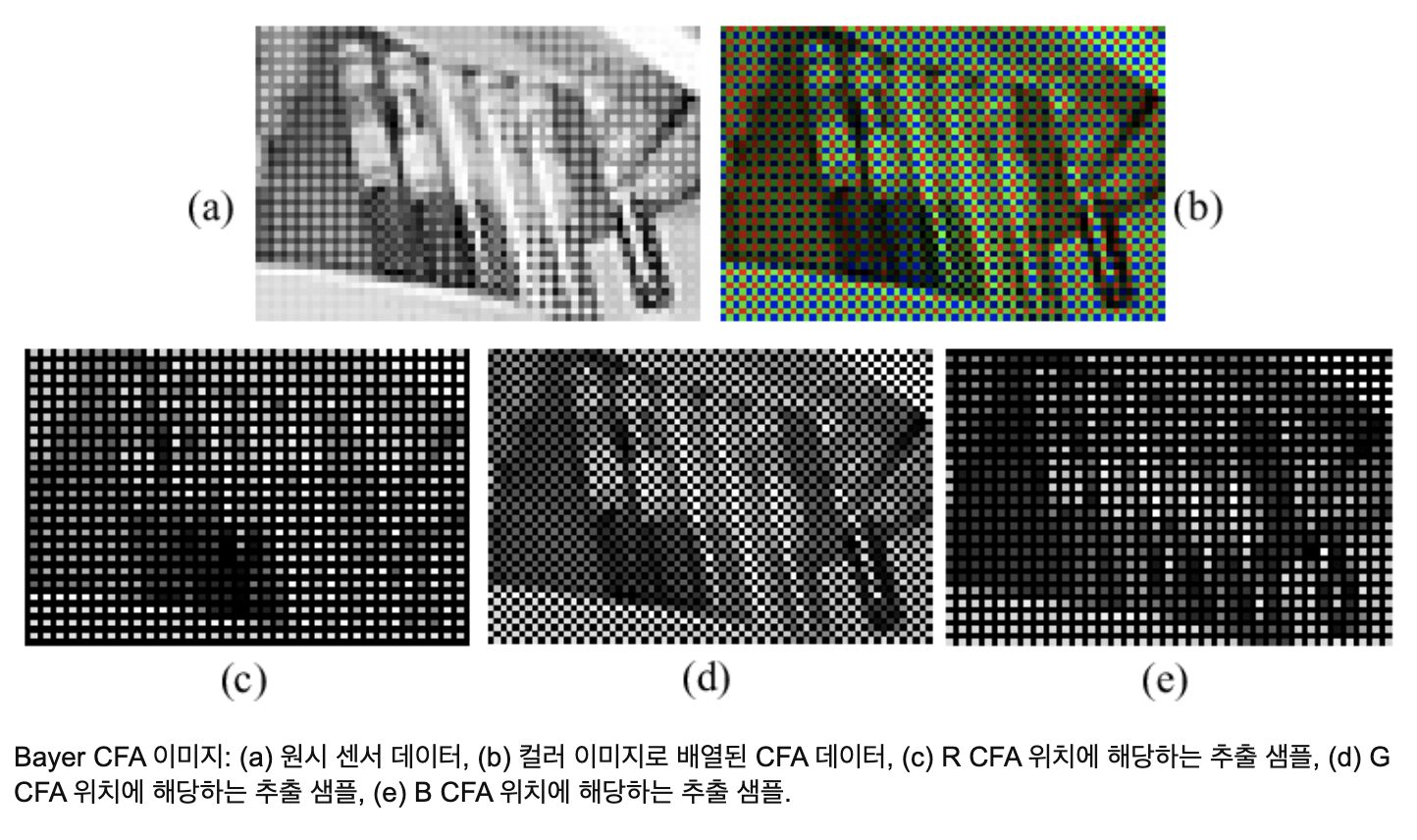

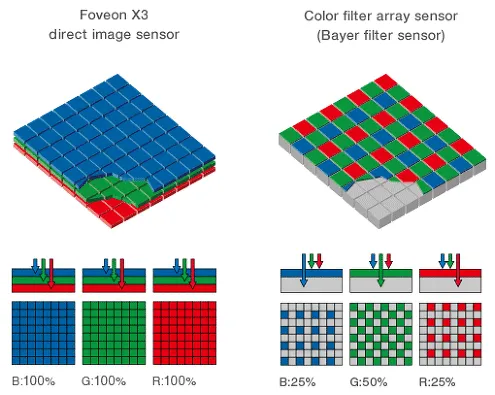

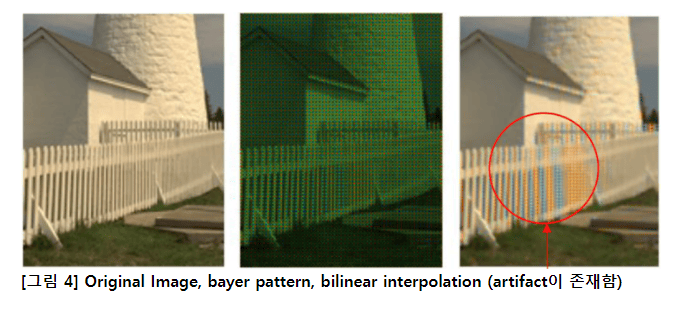

카메라 즉 이미지센서는 원래 흑백(루마=밝기 값)만 감지합니다. 그러면 이제 컬러 이미지를 만들려면 센서 위에 컬러 필터 어레이(CFA)를 배치해야 하는데요. 소니 이미제센서와 흔히 많이 쓰는 픽셀배열은 베이어 패턴(Bayer Pattern) 입니다. 구조 방식의 경우 R,G,B 색상이 각 컬러필터를 교차하면서 배열되고, 전체적인 픽셀 중 절반은 녹색 1/4는 빨간색과 파란색 정보를 얻습니다. CFA 반복 구조는 2×2 이고, 패턴은 G, R x B ,G 입니다. 이제 여기서 맵핑하고 RGB 값을 보충하게 됩니다. 디 모자이킹 방식과 보간 방식은 정말 다양한 종류가 존재합니다.

꼭 제조사에서는 베이어패턴 뿐만 아니라 시그마와 같이 포베온패턴을 사용하곤 합니다. 베이어 패턴의 경우 장 단점이 존재하지만, 해당 포스팅 내용은 색감에 관련하므로 예외로 두겠습니다. 포베온의 경우 RGB 값을 별도의 디 모자이킹 과정 없이 3층으로 분리 필터를 만들었다고 보시면 됩니다. 물론 노이즈, 프로세서 처리, 데이터 크기, 발열과 배터리 등 문제로 시장에서 없어지긴 했습니다..

- 단일센서를 위한 디 모자이킹 기술 및 보간법

https://koreascience.kr › CFKO200932963976657

디모자이킹을 진행 후 무아래와 같은 문제가 있습니다. 이것을 억제하고 제거 하기 위해서는 ISP 모자이킹을 통해 해결하거나, 파니소닉 S1H 와 같이 OLPF (로우패스필터)와 같은 방식도 있습니다. 해당 필터를 사용하면 Aliasing, moire를 감소할 수 있지만, 단점으로 이미지가 선명하지 않고 자칭 부드럽게 나오게 됩니다. 해당 부분도 이미지 색감이나 하이라이트 roll-off 등 다양한 요소로 달리지게 됩니다.

3. 색공간 변환 (Color Space Conversion)

색공간 변형의 경우 카메라의 표준 색공간 (sRGB, Adobe rgb) 등 으로 색 좌표를 변환하는 과정입니다. 각 센서가 받아들이는 원시(RAW) 를 그대로 사용하게 된다면 인간이 볼 수 있는 색 기준과 멀어지기 때문에 카메랑의 ISP(DIGIC, Bionz X 등) ISP 색 보정 매트릭스를 사용하여 표준 색공간으로 변환되는 과정을 거칩니다. (한마디로 사진이나 영상에서의 RAW파일은 특정 기기를 제외한 모두 ISP를 통한 과정입니다)

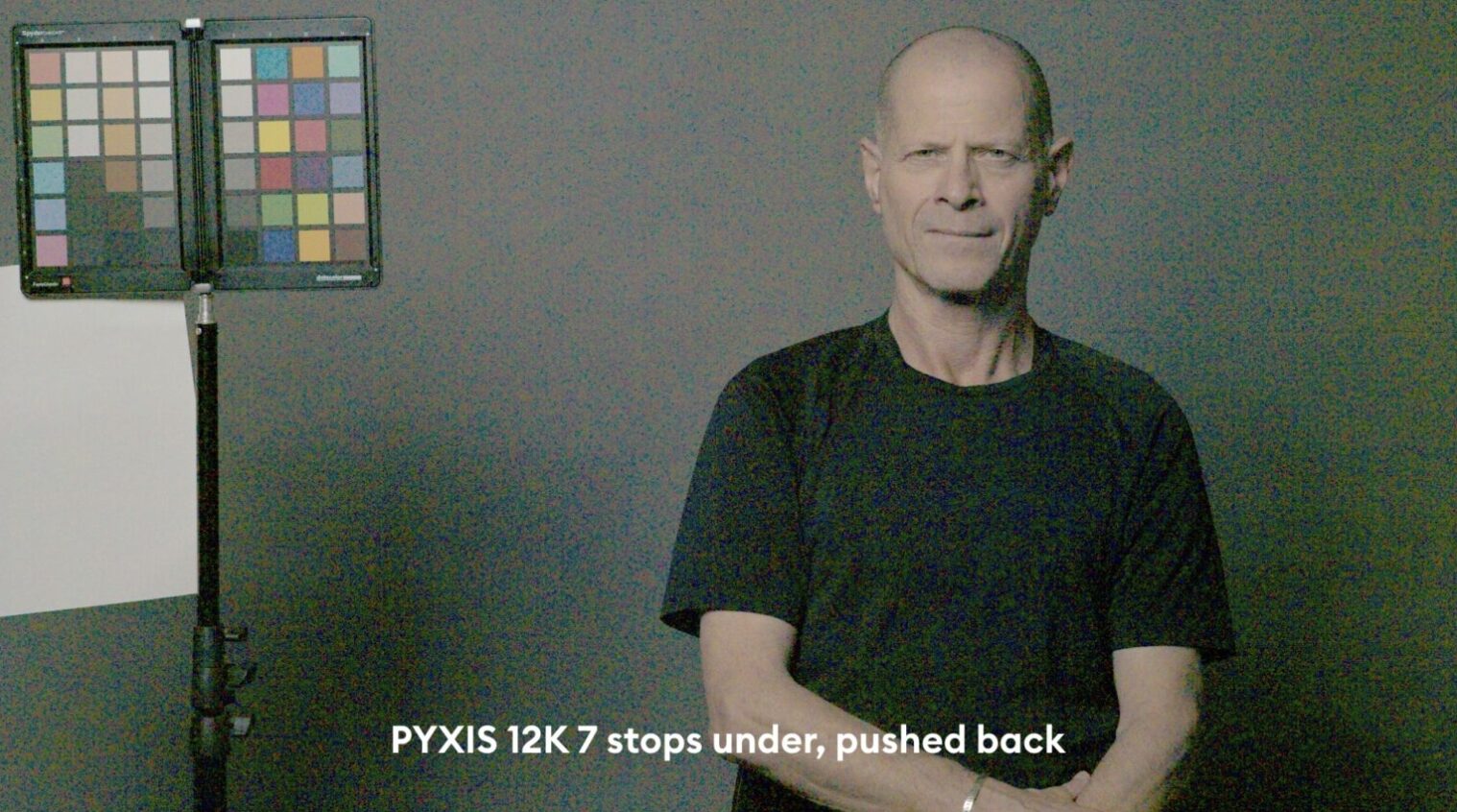

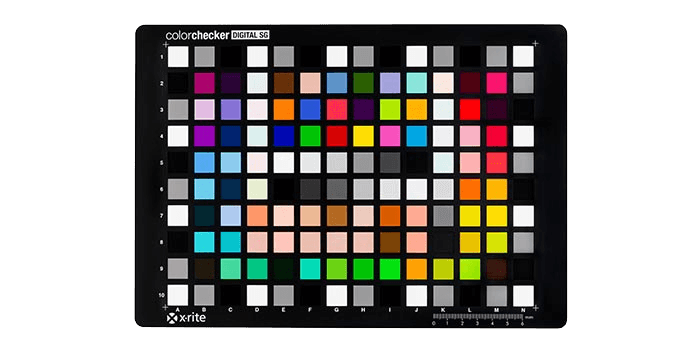

사진이나 영상을 어느정도 알고 있거나 배운 사람들은 한번 쯤 봤을 컬러체커입니다. 카메라 내부 파이프라인에 따라 CIE XYZ 색 좌표계를 변환하는 단계가 있습니다. 하지만 출력이미지가 원본 장면과 일치 하지 않는 경우가 있고, 정확한 색표현을 필요로 하는 경우가 있습니다. 해당 색상에는 가시광선 스펙트럼 넓은 범위를 포괄하는 표준 색상패치고 이것을 바탕으로 색상 프로파일 및 보정 매트릭스로 편차를 줄이는 용도로 사용하게 됩니다.

4. 제조사별 색 렌더링 방식

각 제조사들은 기본 색과 톤을 통해서 각 브랜드만의 공유 색감을 만들기도 합니다. 유명한 ARRI 카메라와 RED카메라 소니, 캐논, 니콘 등 입니다. 실제로 같은 소니제 같은 IMX410 센서를 사용했음에도 불구하고 완전히 다른 컬러감을 만들기도 합니다.

항상 색감이 좋다고 칭송받는 캐논의 경우는 이미 수십 년 전 부터 컬러사이언스를 연구해 왔습니다. 조명 조건고 색 온도를 분석하고 피부색을 자연스럽게 이어지도록 만들었습니다. 실제 캐논에서도 후반작업을 위해 용이하도록 연구 했다는 것을 알 수 있습니다.

• 결론 •

카메라 제조사들은 각 회사에 맞게 의도적으로 컬러사이언스를 연구하고 파이프라인을 일치화 하는데 큰 자본과 기술력이 들어간다. 디모자이크 방식과 톤 매핑, 센서에서 받는 각 스페트럼의 처리 방식, 노이즈와 ISP 처리과정의 차이에 따라 결과물 자체가 달라지게되고, 그게 사진이나 영상의 결과물로 나타나는 것이다.

이해하기 쉽게 설명하자면.. 요즘 감성카메라에 대해 이야기가 많은데 이걸 반증하는 내용이다. 아이폰xs 의 경우 과도한 샤픈처리, 딥퓨전, 과도한 디테일 보간 과정, 모자이킹, AI를 통한 복원작업 등 하지 않았고 그 덕분에 이미지 자체는 노이즈가 많지만 자연스러운 컬러사이언스를 만들어 낸 것이다. 현재 사진의 트랜드는 선명함에 맞춰줘 있다 보니 더욱 적극적으로 기술 연구를 하는게 아닌가 싶다.

• 출처•

https://www.cined.com/blackmagic-pyxis-12k-lab-test-rolling-shutter-dynamic-range-and-exposure-latitude/ (cine d 사진 참고)

https://www.researchgate.net/figure/Bayer-CFA-image-a-raw-sensor-data-b-CFA-data-arranged-as-a-color-image-c_fig1_3181207 (컬러필터 사진 참고자료)

https://karaimer.github.io/beyond-rawRGB-sRGB/#:~:text=color%20space%20is%20dependent%20on,To%20this%20end%2C%20we (컬러색감 프로필에 따른 색상차이)

궁금하거나 질문이 있다면 댓글 주시면 최대한 알려드리겠습니다.

“도움이 되셨다면 공감 버튼을”